이번 시간에는 4주 차 내용을 총정리하는 퀴즈를 풀어보며, 4주 차 강의 내용을 정리하는 시간입니다.

1~10번까지 차례대로 풀어봅시다.

1번 문제

1번 문제는 "캐시"에 관해 묻는 문제입니다.

심층 신경망의 역전파 + 순 전파 강의시간에 "Cache"에 관해서 언급됐습니다.

"Cache"는 활성화 함수의 입력값인 Z [i]를 저장하는 변수로써, 역전파 과정에서 사용하기 위해서 순 전파 과정 중에 저장하는 값이라고 배웠습니다.

즉, 정답은 "2번"입니다.

2번 문제

2번 문제는 "하이퍼 파라미터(=하이퍼 매개변수)"에 관한 문제입니다.

하이퍼 매개변수란, 학습을 통해서 수정되는 W, b와 같은 값이 아니라, 신경망의 크기, 학습률, 히든 레이어의 크기, 반복 횟수, 학습시간 등등

사람이 직접 설정해 주는 값을 의미한다고 배웠습니다.

즉, 정답은 1번, 3번, 4번, 5번입니다.

3번 문제

3번 문제는 신경망에 관해 묻는 문제입니다.

제 블로그의 4 -3 신경망의 층을 왜 깊게 할까?에 언급된 내용입니다.

신경망의 층을 깊게 할수록, 좀 더 복잡한 기능을 수행한다고 배웠습니다.

즉, 정답은 "2번"입니다.

4번 문제

4번 문제는 벡터화에 관해 묻는 문제입니다.

벡터화를 사용하면 for 구문을 어느 정도 대체할 수 있는 건 맞지만,

L 층을 코드로 작성할 때는 for 구문을 써야 합니다.

즉, 정답은 "거짓"입니다.

5번 문제

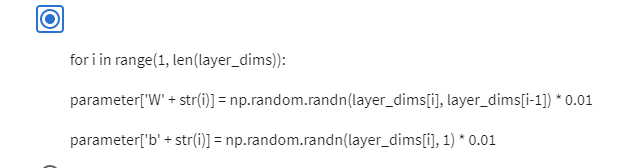

5번 문제는 for 루프에 관한 코딩을 묻는 문제입니다.

layer는 1~ layer_dims까지 존재합니다. ----> 위의 예시에서는 신경망의 층이 4층입니다.

W의 모양은 ( n 층의 퍼셉트론 수, n-1 층의 퍼셉트론의 수)이고,

b의 모양은 ( n 층의 퍼셉트론의 수 * 1)입니다.

np.random.randn은 랜덤 한 난수를 생성하는 코드입니다.

0.01을 곱하는 건, 숫자를 줄이기 위해서입니다.

즉 정리하자면, 정답은 "3번"입니다.

6번 문제

L 레이어의 수는 퍼셉트론이 존재하는 층만 세면 되므로 4층입니다.

숨겨진 레이어는 걸과 층을 제외한 3층입니다.

참고 ----> L 레이어의 수를 셀 때, 입력 값 X가 존재하는 층은 세지 않습니다.

즉, 정답은 "1번"입니다.

7번 문제

7번 문제는 활성화 함수에 대한 이해도를 묻는 문제입니다.

순 전파 과정에서 활성화 함수는 직접적으로 쓰이기 때문에 당연히 알아야 합니다.

역전파 과정에서도 도함수 값을 통해서 직접적으로 쓰이기 때문에 당연히 알아야 합니다.

즉, 정답은 "참"입니다.

8번 문제

8번 문제는 신경망의 이해도에 관해 묻는 문제입니다.

3번 문제와 마찬가지로, 제 블로그의 "4 - 3 심층만을 왜 깊게 사용하는지"에 언급된 내용입니다.

논리 이론에 근거하여, 신경망을 깊게 사용하면 얕게 사용하는 것보다 연산량을 기하급수적으로 줄일 수 있다고 배웠습니다.

즉, 답은 "참"입니다.

9번 문제

9번 문제는 신경망에서 사용되는 매개변수의 모양(=차원 수)에 관해 묻는 문제입니다.

일단, 가중치 W의 모양부터 알아봅시다.

W [1]의 모양은 (1층의 퍼셉트론 수 * 0층의 퍼셉트론 수)이므로, (4 * 4)입니다.

W [2]의 모양은 마찬가지로 (2층의 퍼셉트론의 수 * 1층의 퍼셉트론의 수)이므로, ( 3 * 4)입니다.

W [3]의 모양은 마찬가지로 ( 1 * 3)입니다.

편향 b의 모양은 더 간단합니다.

b [1]의 모양은 (1층의 퍼셉트론의 수 * 1)이므로, (4*1)입니다.

b [2] , b [3]의 모양은 마찬가지로 (3,1) , ( 1,1)입니다.

즉, 정답은 아래의 모습입니다.

10번 문제

10번 문제도 마찬가지로 매개변수의 모양을 묻는 문제입니다.

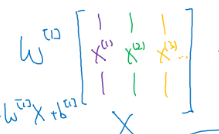

아까 언급했듯이, W [l]의 모양은 ( n 층의 퍼셉트론의 수 * n-1 층의 퍼셉트론의 수)입니다.

즉, 정답은 "4번"입니다.

++ W의 모양이 왜 저런지는 아래의 그림 참고

---> 가로의 수는 0층의 퍼셉트론의 수, 세로는 1층의 퍼셉트론의 수를 나타냄

이상으로 4주 차 총정리 퀴즈를 마치도록 하겠습니다.

다음 시간에는 배운 내용을 바탕으로 직접 프로그래밍해 보며, 직접 심층 신경망을 구현해 보도록 하겠습니다.

읽어주셔서 감사드리며, 궁금하신 점이나 의문이 있으시다면 댓글 남겨주세요!

'코세라 앤드류 응 AI 강의 리뷰' 카테고리의 다른 글

| [인공지능 강의 리뷰] 28 - 프로그래밍 과제. 심층 신경망 구축하기 2편 (0) | 2022.07.29 |

|---|---|

| [인공지능 강의 리뷰] 27 - 프로그래밍 과제. 심층 신경망 구축하기 1편 (0) | 2022.07.29 |

| [인공지능 강의 리뷰] 25 - 매개변수와 하이퍼 매개변수의 차이점 +뇌와 딥러닝의 관련성 (0) | 2022.07.29 |

| [인공지능 강의 리뷰] 24 - 심층 신경망에서의 순전파(forward propagation) + 역전파(back propagation) (0) | 2022.07.16 |

| [인공지능 강의 리뷰] 23 - 왜 신경망의 층을 깊게하는 걸까? ( why deep repretations?) (0) | 2022.07.05 |

| [인공지능 강의 리뷰] 22 - 딥러닝에서 행렬의 크기 알아보기(Getting your matrix dimensions right) (0) | 2022.06.01 |

| [인공지능 강의 리뷰] 21 - L층의 뉴럴 네크워크(Deep L-layer Neural Networks) (0) | 2022.05.31 |